En fin de semaine dernière, nous vous avons informé d'une nouveauté plutôt intéressante, à savoir un nouveau système de détection d'images représentant des abus sur des enfants. Concrètement, Apple analysera toutes les photos stockées sur iCloud et, en cas de détection, signalera ces cas aux autorités compétentes. Bien que le système fonctionne "en toute sécurité" au sein de l'appareil, le géant a tout de même été critiqué pour violation de la vie privée, ce qui a également été annoncé par le célèbre lanceur d'alerte Edward Snowden.

Il pourrait être vous intéresse

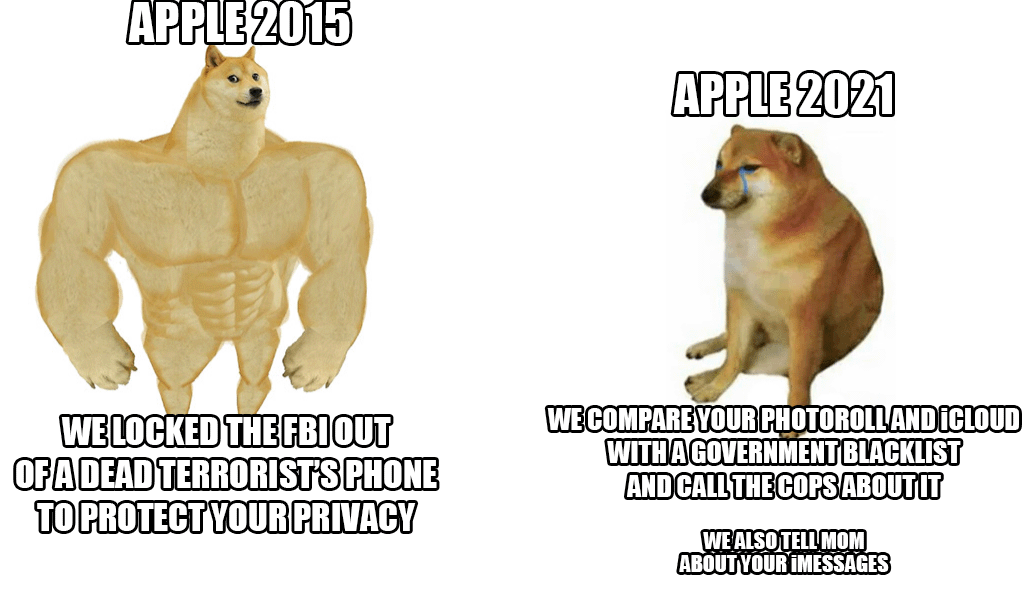

Le problème est qu’Apple s’est jusqu’à présent appuyé sur la vie privée de ses utilisateurs, qu’elle souhaite protéger en toutes circonstances. Mais cette nouvelle bouleverse directement leur attitude originelle. Les pomiculteurs sont littéralement mis devant le fait accompli et doivent choisir entre deux options. Soit ils disposeront d'un système spécial qui analysera toutes les images stockées sur iCloud, soit ils cesseront d'utiliser les photos iCloud. Le tout fonctionnera alors tout simplement. L'iPhone téléchargera une base de données de hachages, puis les comparera avec les photos. Parallèlement, il interviendra également dans l'actualité, où il est censé protéger les enfants et informer en temps utile les parents des comportements à risque. Le souci vient alors du fait que quelqu'un pourrait abuser de la base de données elle-même, ou pire encore, que le système puisse analyser non seulement les photos, mais aussi les messages et toutes les activités, par exemple.

Bien entendu, Apple devait répondre aux critiques le plus rapidement possible. Pour cette raison, par exemple, il a publié un document FAQ et a désormais confirmé que le système numériserait uniquement les photos, mais pas les vidéos. Ils le décrivent également comme une version plus respectueuse de la vie privée que celle utilisée par d’autres géants de la technologie. Dans le même temps, la société Apple a décrit de manière encore plus précise comment tout cela fonctionnerait réellement. S'il y a une correspondance lors de la comparaison de la base de données avec les images sur iCloud, un bon sécurisé cryptographiquement est créé à cet effet.

Comme déjà mentionné ci-dessus, le système sera également relativement facile à contourner, ce qui a été confirmé directement par Apple. Dans ce cas, désactivez simplement Photos sur iCloud, ce qui permet de contourner facilement le processus de vérification. Mais une question se pose. Est-ce que ça vaut le coup? Quoi qu’il en soit, la bonne nouvelle reste que le système n’est mis en œuvre qu’aux États-Unis d’Amérique, du moins pour le moment. Comment voyez-vous ce système ? Seriez-vous favorable à son introduction dans les pays de l’Union européenne, ou s’agit-il d’une trop grande intrusion dans la vie privée ?

Eh bien, c'est compliqué. Bien entendu, la protection de la vie privée passe avant tout. C'est aussi l'une des raisons pour lesquelles j'utilise cette plateforme. Mais tout a ses limites. En bref, toute liberté prend fin là où elle porte atteinte à la liberté d'autrui. Il est clair que des mesures doivent être prises contre toute personne prête à faire du mal ou à maltraiter des enfants. C'est sans débat.

Comme déjà mentionné ci-dessus, le système sera également relativement facile à contourner, ce qui a été confirmé directement par Apple. Dans ce cas, désactivez simplement Photos sur iCloud, ce qui permet de contourner facilement le processus de vérification.

Parce que cela signifie en même temps désactiver l'album partagé. Comme c'est simple cher Watson :)

Fouiller automatiquement les photos sans l’autorisation de l’autorité désignée est en principe une erreur, et je vous parie que ce n’est que la première étape. Il y a tellement de choses qui peuvent être faites, qui sont justifiables au début et qui ne peuvent plus être arrêtées. Pédopornographie -> commerce de viande blanche -> cruauté envers les animaux -> ne pas faire attention à la conduite -> participation aux événements de l'opposition des soirées...

Le problème est de savoir ce qui rend ce processus possible. Pourquoi le fabricant du téléphone et du système d'exploitation doit-il nous dire ce qu'il doit contenir en tant qu'utilisateur ? Bien sûr, surtout pour les bons enfants, c'est très agréable à écouter, c'est pourquoi Apple sponsorise même un appareil de pointe qui traite de ce problème. Pourquoi les organisations à but non lucratif résolvent-elles le problème, parce que les enfants ne s’intéressent pas à l’État ? Cela ne me dérange pas vraiment si je ne fais rien de mal, mais ils font de chaque utilisateur d'iPhone/iPad des criminels potentiels. C'est une logique tordue, je dirais que l'une des solutions les plus simples, nous allons scanner vos photos en toute sécurité. Ainsi, tous ceux qui m'envoient de la pédopornographie via iMessage sont frustrés de savoir que je suis un criminel et que je serai tenu responsable envers une entreprise privée de quelque chose qui ne m'intéresse pas et en attendant, je ne me connecterai pas car l'identité sera bloquée. Et tous les gens frustrés qui sont tellement stupides qu'ils partagent les photos de leurs enfants et les sauvegardent dans le cloud, iront ailleurs parce que les gens les plus stupides se laissent prendre par là. Plus quelques parents qui ont accidentellement pris une photo de leur progéniture avec un pindik/pipinka. Bien joué.

Pourquoi attraperaient-ils les parents qui ont pris une photo de leur progéniture nue ? Ça ne marche pas comme ça

Oui, je l'ai mal écrit, donc ça ne fonctionnera probablement pas. Et plus loin ?